Hace tiempo que la inteligencia artificial (IA) abandonó la categoría de la ciencia ficción y empezó a convertirse en una realidad. Uno de sus grandes exponentes fue la victoria de la supercomputadora Deep Blue frente al campeón del mundo de ajedrez Gary Kasparov en 1997. Este hito ha venido seguido por otros, como la victoria de la supercomputadora Watson, también de IBM, en el concurso de preguntas y respuestas de televisión Jeopardy en 2011 o, más recientemente, la victoria de AlphaGo de Google en 2016 al campeón coreano del juego de mesa Go.

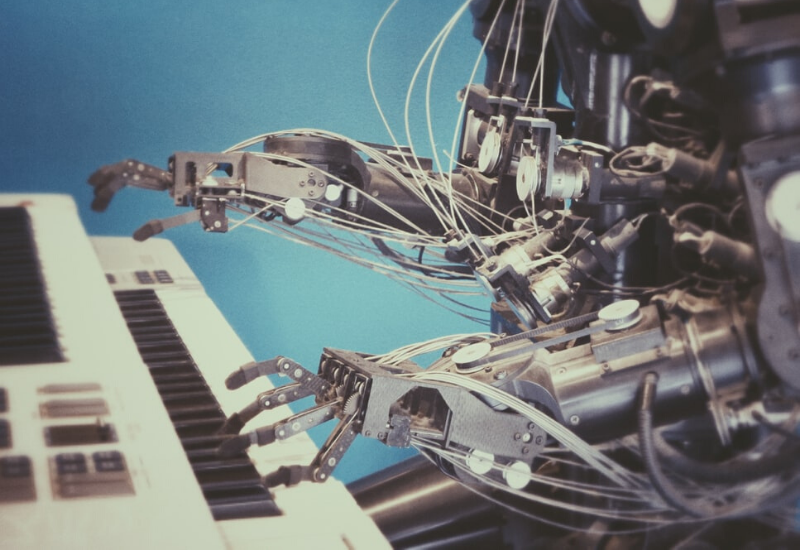

Junto a estos grandes hitos, quizás algo lejanos y distantes de nuestra cotidianidad, también hemos visto cómo la IA tiende a integrarse cada vez más en nuestro día a día. Ya disponemos de robots autónomos que limpian nuestra casa, filtros anti spam que eliminan los mensajes de correo no deseado, numerosas herramientas de diagnóstico médico automatizado, o los algoritmos que nos ayudan a descubrir nuevas canciones o grupos de música que no conocíamos y pueden terminar convirtiéndose en nuestros favoritos. Éstas y muchas otras son aplicaciones actuales de la IA que, poco a poco, van permeando nuestra cotidianidad, y cada vez lo harán en mayor medida.

El científico y escritor Raymond Kurzweil ha llegado a plantear la futura y no tan lejana aparición de lo que él define como la singularidad. Kurzweil defiende que de acuerdo al avance de la tecnología y de la capacidad de cómputo (de tipo exponencial) llegará un momento en torno al año 2045 en el que se darán las condiciones para que se alcance lo que él denomina la singularidad. Esta consistiría en una fusión entre tecnología e inteligencia humana, en donde la tecnología dominará los métodos de la biología y supondrá una evolución de la concepción humana, que trascenderá nuestras raíces biológicas y tendría consecuencias difíciles de predecir, de ahí el nombre de singularidad. Un reflejo de esta teoría son las numerosas películas que lo abordan desde diferentes perspectivas que van desde la visión apocalíptica de Terminator a la tranquilidad de Her pasando por otras opciones como Ex_Machina o incluso la distópica Matrix.

Esta propuesta supone que alcanzaremos una inteligencia ampliada, una longevidad extendida o incluso estados de súper felicidad. Pero esta concepción tan optimista también debe tener en cuenta las componentes éticas, sociales, culturales, económicas, filosóficas, o espirituales tan propias de lo humano. Estas componentes no son menores y su enfoque es muy diferente de unas culturas a otras, incluso con concepciones y valores opuestos. De alguna forma sería como querer dar un salto adelante sin tener una base sólida y sin saber muy bien dónde se va a caer. Hay mucho interés en dar el salto, pero este podría ser estrepitoso o incluso lesivo para el saltador. La tesis de la singularidad tiene sus críticas y algunas no menores.

Nadie pone en duda el desarrollo tecnológico a nivel de cómputo y de cálculo para analizar posibles escenarios y sus evoluciones. Ya hemos hablado del ejemplo de Deep Blue contra Kasparov, pero aun resultan de mayor interés las aplicaciones prácticas como: regular el tráfico de una ciudad, comprender y analizar la escritura y el lenguaje humano, el reconocimiento de caras o la conducción autónoma. Son claros los adelantos que se han logrado, pero hay elementos plenamente humanos, que son muy difíciles de parametrizar e incorporar a una IA. Uno de ellos es el sentido común, algo muy cultural, de mucha amplitud y con límites muy difusos, ¿cómo se podría programar? El otro elemento, aún más complejo, es el de la consciencia, algo sobre lo que todavía no hemos alcanzado una conclusión definitiva. Sería un tanto presuntuoso aplicarlo a una IA cuando ni siquiera existe un consenso sobre su definición.

Puesto que el test de Turing (1950) todavía no ha sido superado por ninguna IA, podemos afirmar que aún estamos lejos del escenario de la singularidad que requeriría de una IA fuerte que pueda competir o alcanzar a la inteligencia humana. Las IAs actuales son de tipo débil, es decir, están orientadas a problemas concretos, no generales; las programa un humano, no lo hacen ellas de forma autónoma; no razonan, solo calculan; aprenden de ejemplos y entornos similares; realizan tareas repetitivas y no pueden salirse de su marco de trabajo.

Las IA se basan en el modelo de las redes neuronales, que requiere de una fuerte base matemática centrada en el cálculo y la estadística. Para su implementación efectiva entran en juego los sistemas informáticos que convierten en código estas funciones matemáticas y permiten realizar un gran número de cálculos en un tiempo reducido haciendo que estos procesos alcancen una utilidad real. Además de estas ciencias en la IA intervienen numerosos elementos de otras ramas científicas como la filosofía, la psicología, la lingüística, la economía, la neurociencia o la ética.

Según se van superando etapas y se alcanzan desarrollos más prometedores surgen preguntas más difíciles de afrontar en las que las ciencias sociales relacionadas juegan un papel relevante. Y entre ellas, últimamente destaca cada vez más la ética conforme hay que enfrentarse a problemas concretos y reales. Un buen ejemplo es la iniciativa de la máquina moral del MIT que nos ayuda a entender la respuesta humana al enfrentarnos al problema de un coche autónomo con una avería y que debe decidir entre atropellar a dos grupos de personas con diferentes rasgos. Os invito a probarlo, puede que os sorprenda hacía dónde se desvía vuestra ética.

Conforme aumentan las aplicaciones de la IA ya hay algunos países y empresas que se han reunido para regular los límites de la IA y van alcanzando algunos consensos. Así ya se habla de la necesidad de que las IA sean justas y que no tomen decisiones que puedan crear algún tipo de discriminación de tipo, racial, ideológica, religiosa, etc. También se exige que sean claras y transparentes para el usuario con respecto a su funcionamiento y los datos que usan. O que en la ejecución de sus funciones debe estar claro a quién se le atribuye la responsabilidad de sus efectos y que deben atender a los valores comúnmente aceptados por la sociedad.

Las posibilidades actuales de la IA son muchas, y parecen aumentar en el futuro que se abre delante de nosotros. También se perciben posibles riesgos que podrían incrementar la fractura social, degenerando incluso en una humanidad a dos velocidades, la que tiene acceso a la IA y la que no. Al igual que sucede con cualquier tecnología, debemos aprovechar su potencial en favor del bien común para alcanzar mayores cotas de justicia e igualdad y que realmente nos hagan más humanos.